تا به تازگی، OpenAI مدل زبان طبیعی جدیدی به نام GPT-3 را معرفی کرده است که عملکرد آن مشابه مدلهای قبلی است. ممکن است برایتان سوال باشد که GPT-3 چیست؟ این مدل به خاطر ویژگیهای خاصش از جمله داشتن ۱۰ برابر پارامتر بیشتر نسبت به بزرگترین مدل قبلی و آموزش بر روی مجموعه دادههای بسیار بزرگتر از نسخههای پیشین، تمایز پیدا میکند. این تفاوت عددی بزرگ به GPT-3 قدرت و قابلیتهای منحصر به فردی میبخشد.

این ویژگیها به GPT-3 این امکان را میدهند که در مقایسه با نسخههای قبلی، پیشرفتهای کیفی چشمگیری داشته باشد. برخلاف نسخههای قبلی، GPT-3 قادر است بدون نیاز به آموزش خاص برای وظایف متنوع، به خوبی عمل کند. این ویژگیها موجب تحسین گستردهای در دنیای فناوری و رسانهها شده است. با وجود پیشرفتهای قابل توجه GPT-3، محدودیتها و کاربردهای خاص آن نیز در بررسیهای مختلف مورد توجه قرار گرفتهاند. در ادامه به برخی از این محدودیتها خواهیم پرداخت.

داستان GPT-3 از کجا شروع شد؟

در ۲۸ ام ماه می، OpenAI در مقالهای به نام «مدلهای زبانی فراگیرانی سریع هستند». GPT-3 را به عنوان بزرگترین مدل زبان که تا کنون ساخته شده است معرفی کرد. در این مقالهی ۷۳ صفحهای، نشان میدهد که چطور GPT-3 ترندهای جدید پیشرفتهای هنرمندانه در مدلسازی زبانها را دنبال میکند. به طور گسترده، در بنچمارکهای پردازش زبان طبیعی، GPT-3 به نتایج امیدوارکننده و قابل رقابت میرسد.

GPT-3 افزایش کارایی که از استفاده یک مدل بزرگتر میآید را نشان میدهد. و دنبالهرو افزایش عظیم در مدل و اندازه اطلاعات است. که جدیدترین پیشرفتهای NLP را توصیف میکند. پیام اصلی این بیانیه بیشتر از این که در مورد کارایی این مدل در بنچمارکها باشد. در مورد این کشف بوده که به خاطر مقیاسش، GPT-3 قادر است تا وظایفی در NLP که تاکنون با آنها روبهرو نشده است. را بعد از یک بار دیدن و یا تعداد کمی مثال حل کند. این مساله در تضاد با چیزی است که امروزه انجام میشود. این که مدلها برای دستورات جدید باید با حجم عظیمی از اطلاعات تمرین داده شوند.

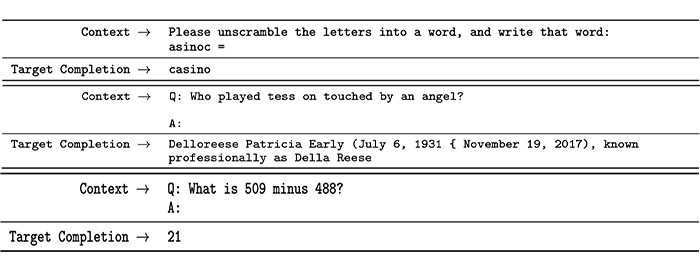

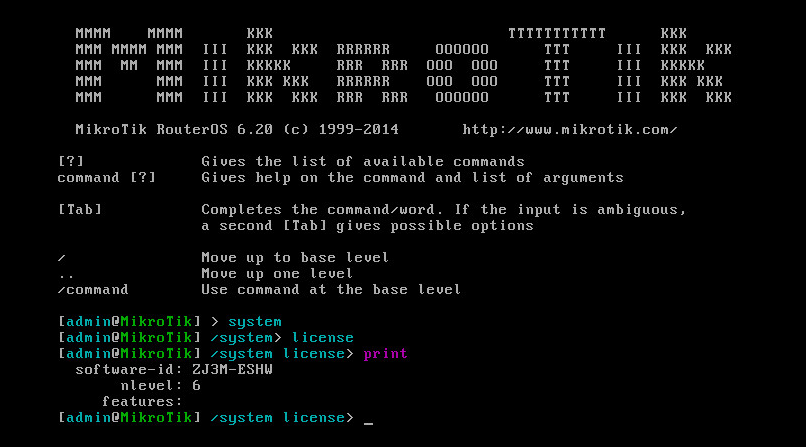

این تصویر مثالهایی را از روش GPT-3 (سمت چپ) و روش تنظیم قدیمی (سمت راست) نشان میدهد. زمانی که آپدیتهای متحرک (gradient updates) انجام میشوند، به این معنی است که نمایشگرهای داخلی مدل برای اطلاعات جدید تنظیم شده اند.

سال گذشته، OpenAI نسخه دوم GPT را توسعه داد. که قادر بود متونی طولانی و منسجم تولید کند که تمایز آن با نوشتهی انسانها سخت بود. OpenAI بیان میکند که از مدل و ساختار GPT-2 در محصول جدید خود بهره برده است. ولی تفاوتی که دارد این است که اندازه شبکه و اطلاعاتی که با آن آموزش داده میشود بسیار بزرگتر از نسخهها قبلی خود بوده است.

GPT-3 در مقایسه با GPT-2 که ۱.۵ میلیارد مولفه داشته، ۱۷۵ میلیارد مولفه دارد و برخلاف GPT-2 که بر روی ۴۰ میلیارد گیگابایت متن بوده. GPT-3 بر روی ۵۷۰ میلیارد گیگابایت متن تمرین داده شده است. با این حال افزایش این مقیاس بدعت جدیدی نیست. چیزی که GPT-3 را مهم کرده یادگیری با گزینههای اندک (few-shot learning) است. که با مثالهای متفاوتی در زمینهی فعالیتهای زبان طبیعی در مثال زیر نشان دادهایم.

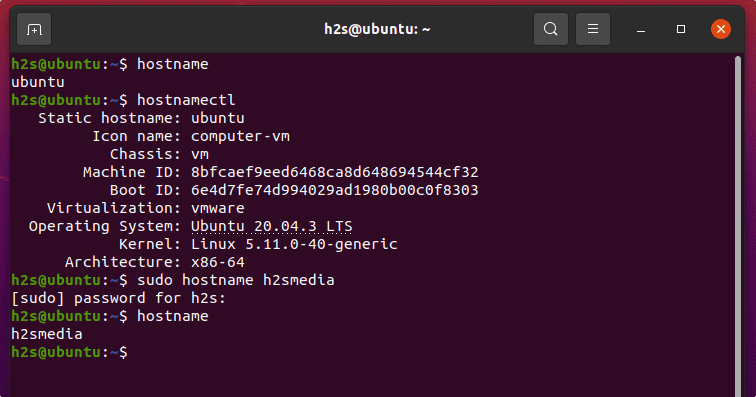

مثالهایی از GPT-3 در حال جواب دادن به سوالات در برگه

در ادامه پخش مقاله، بیان شد که در تاریخ ۱۱ ژوئن، دسترسی به GPT-3 برای توسعهدهندگان شخص ثالث از طریق رابط برنامهنویسی نرمافزار OpenAI .اولین محصول تبلیغاتی و در مرحله تست بتا، میسر باشد. دسترسی به GPT-3 فقط از طریف دعوتنامه ممکن است و هنوز قیمتگذاری نشده است.

بعد از پخش توسط رابط برنامهنویسی نرمافزار OpenAI، به دلیل نمایشهای بینظیر GPT-3 و پتانسیلهای آن (همچنین در نوشتن مقالههای کوتاه، پستهای وبلاگ و تولید متون خلاقانهی تخیلی). بحثهای زیادی در بین جامعهی هوشمصنوعی و فراتر از آن بهوجود آمد. یکی از بهترین مثالهای نمایش این پتانسیل، به وجود آوردن جاوااسکریپت تهنا با یک توضیح ساده در زبان انگلیسی است.

با استفاده از GPT-3، من پردازندهی صفحهای درست کردم که تنها با توضیح یک قالب، میتواند کد JSX را برای شما آماده کند.

در اینجا یک پلاگین GPT-3 را میبینید که با گرفتن یک آدرس اینترنتی و توضیحاتش میتواند یک وبسایت جعلی شبیه به نسخه اصلی درست کند.

بعد از ساعتها فکر کردن روی نحوهی کار این، یک نسخهی دموی GPT-3 فوق العاده را تست کردم. من هم با انسجام تست GPT-3 مبهوت ماندهام و هم با ظرافتش شگفتزده شدهام. بیایید قضیه اساسی حساب را با این امتحان کنیم.

بعد از دریافت دسترسی دانشگاهی، من در مورد نرمافزارهای GPT-3 و شناخت آن در بخش زبانها فکر میکردم. در این فکر کردن، به دموی جدیدی رسیدم، کاربرد لوازم جانبی، با یک شی چه کارهایی میتوان انجام داد؟

بازخوردهای GPT-3

رسانهها، متخصصان این زمنیه و انجمنهای تکنولوژی گستردهای نظرات متفاوتی پیرامون تواناییها و پتانسلهای GPT-3 و پیادهسازی آن در مقیاسهای بزرگتر دارند؛ نظراتی شامل خوشبینی به بهرهوری بیشتر انسانها در آینده و ترس از دستدادن شغلها و همینطور بررسیهای دقیق تواناییها و محدودیتهای GPT-3.

بازخورد رسانههای در مورد GPT-3 چیست؟

پوشش این مسئله توسط رسانهها از زمانی که نسخههای دمو منتشر شدند افزایش یافت:

- بازخورد موسسه تکنولوژی MIT درباره GPT-3، همراه با ارائهی منابع مختلفی نشان داد که چگونه میتواند متونی شبیه انسانها خلق کند؛ از تولید کدهای react گرفته تا سرودن شعر. این موسسه در مورد GPT-3 خاطر نشان کرد: «این فناوری میتواند نوشتههای شبیه انسان بسازد اما نمیتواند ما را به هوش واقعی نزدیکتر کند.»

- موسسه Verge بر روی پتانسیلهای تبلغاتی نرمافزارهای GPT-3 تمرکز کرد.

- در پی بحثهای پیرامون این موضوع، منابع خبری مانند Forbes و Venturebeat مشکلاتی مانند مدل Bias و Hype را بررسی کردند.

- اضافه بر ذکر کردن عیوب آن، Wired بیان کرد که GPT-3 میتواند نسخهی جدیدتر و خطرناکتری از تکنولوژی Deepfake را به ما معرفی کند که باعث میشود رسانهای دستکاری نشده برای مقایسه با نمونههای دستکاری شده نباشد. متون مصنوعی معمولا به راحتی در حجم زیاد میتوانند منتشر شوند و به راحتی نمیتوان آنها را شناخت.

- روزنامه نیویورکتایمز نیز مطلبی با تیتر «نسل جدید هوش مصنوعی بسیار جالب و کمی ترسناک است» منتشر کرد. در مورد اینکه GPT-3 جایگزین نویسندهها خواهد شد و این جای نگرانی دارد.

- در آخر جان ناتن، پروفسور «فراگیری عمومی فناوری» دانشگاه Open و یکی از نویسندگان گاردین، GPT-3 را فقط به عنوان پیشرفتی افزونبر پیشینیان این تکنولوژی میبیند. نه این که کشف جدید و مهمی باشد. ناتن این هشدار را میدهد که اگر این پیشرفتها به خاطر ارائهی هر چه بیشتر دادهها باشد. هزینههای جانبی آن در آینده بسیار هنگفت خواهد شد.

بازخورد متخصصان هوش مصنوعی در مورد GPT-3 چیست؟

در مقابل نظرات رسانهها، بازخوردهای متخصصان یادگیری ماشین و روشهای زبان طبیعی بیشتر به خاطر کنجکاوی و تمرکز بر روی چگونگی استفاده از GPT-3 بود. و هم چنین یافتن اینکه چقدر توانایی در فهمیدن کامل زبان انسانها دارد.

- سردبیر بخش تحقیقات هوش مصنوعی NVIDIA و پروفسور علوم ریاضی و حساب در Caltech، انیما آنندکوماد، از OpenAI این انتقاد را کرد که چرا به Bias به اندازه کافی توجه نکردند، با توجه به این که GPT-2 نیز مشکلاتی شبیه به این مدل جدید داشت. به دلیل این که منابع اطلاعاتی مدیریتنشدهای مانند Reddit در این تکنولوژی استفاده شده و برای نوشتن متن از انسانها تاثیر گرفته است.

- مدیر هوشمصنوعی فیسبوک، جروم پزنتی، نیز نظرات مشابهی داشت: GPT-3 خلاقانه و جالب است ولی برای از جنبههای حقوق بشری میتواند مضر باشد. وقتی از GPT-3 میخواهیم با کلماتی مانند یهودیان، سیاه، زنان و هولوکاست توییت بزند، به نتایج زنندهای ممکن است دست پیدا کنیم. ما به پیشرفتهای بیشتری در مورد «هوش مصنوعی مسئولیتپذیر یا responsiveAI» قبل از این که آن را در دسترس عموم قرار بدهیم نیاز داریم.

- دلیپ رائو، محقق یادگیری ماشین، با پستی در وبلاگش در مورد همهی این مباحث پاسخ داد که جو ایجاد شده در فضای مجازی در مورد فناوریهای نوظهور ممکن است گمراهکننده باشد. GPT-3 و نسخههای پشتسر آن فناوری یادگیری با دادههای کم یا few-shot learning از مرحلهی تحقیقاتی به مرحلهی عملیاتی و کاربردی برسند. ولی هرگونه جهش تکنولوژی از حجم زیادی صحبتها و بحثهای درون شبکههای اجتماعی میآید که میتوانند تفکر ما در مورد تواناییهای واقعی این فناوریها را مخدوش کنند.

- جولیان توگلیوس، یک پروفسور هوش مصنوعی در NYU، نیز در مورد این موضوع در وبلاگش پستی با موضوع «یک تاریخچهی بسیار کوچک از زمانهایی که ما هوش مصنوعی را حل کردیم» منتشر میکند. در آن پست به جهش تکنولوژی در GPT-3 اشاره میکند ولی دلایلی برای پایین آوردن هیجانات را بنابر پیشنهی تاریخی هوش مصنوعی نیز میآورد. «الگوریتمها برای جستوجو، بهینهسازی و یادگیری روزی دغدغههایی برای ما داشتند؛ مثلا چگونه بشریت در حال سقوط و جایگزینی آن با ماشینها است! اما دیگر امروزه این الگوریتمها نرمافزارها و محصولات ما را مدیریت میکنند و بهرهوری آنها را افزایش میدهند. بازیها و اپلیکشینهای گوشی و ماشینها نیز از این مسئله مثتثنا نیستند. الان که این تکنولوژی به طرز قابل اعتمادی کار میکند دیگر نمیتوان اسمش را هوش مصنوعی گذاشت؛ بلکه این مسائل کمی خستهکننده شدهاند!»

بازخورد صنایع لبه علم دنیا در مورد GPT-3 چیست؟

مفسران از صنایع تکنولوژی برخوردهای متفاوتی داشتند و تعدادی نیز مفاهیم برنامهنویسی هوش مصنوعی را توضیح دادند.

- مکس ولف، دانشمند داده در بازفید، اهمیت این که انتظارات ما در سنجش GPT-3 چه تاثیری دارد را گوشزد کرد. چون معمولا مسائلی که به عنوان هوش گزارش میشوند از بهترین نمونهها انتخاب میشوند. با این که، متن به دست آمده توسط GPT-3 از مدلهای زبانی دیگر بهتر بوده است، چون این مدل به خودی خود بسیار کند، بزرگ و نیاز به تمرین با دادههای زیاد دارد، تنظیم آن برای کارکردن با اطلاعات اختصاصی میتواند ممکن نباشد.

- کوین لکر، از مهندسان گوگل و موسس استارتاپ Parse، نشان داده که GPT-3 میتواند پاسخهای دقیقی به بسیاری از سوالاتی که در مورد واقعیتهای جهان از آن پرسیده میشود بدهد. این فناوری میتواند آنها را به راحتی از طریق مجموعه نوشتههای تمرینیاش به دست آورد. بلاگری به نام گوون برانون نیز GPT-3 را با بسیاری از نمونهکارها و موضوعات سنجیده است.

آقای برت گلدستین، کارآفرین و مدیرسابق بخش محصولات گوگل، در پاسخ به اینکه GPT-3 چگونه میتواند بر اساس مشخصات داده شده به آن توسط انسان، کد نویسی کند میگوید: «زمینههای سادهی کد نویسی به سختی مورد حمله قرار میگیرند. این مسئله برای طراحی نیز ممکن است… بسیاری از شرکتها تمایل به استفاده از GPT-3 را خواهند داشت تا اینکه مهندسان گرانقیمت یادگیری ماشین را استخدام کنند تا مدلهای کم قدرتتر خود را برای این کار تمرین بدهند. دانشمندان داده، عوامل پشتیبانی مشترکین، دستیارهای قانونی و شغلهای بسیار دیگری در مواجهه با ریسک بسیار بزرگی هستند.»

- در پاسخ به دموهای مختلفی از GPT-3 که تواناییهای آن را نشان میدهند، کاربر ردیت به نام rueracine، بحثی در مورد مسیرهای شغلی در دنیای پس GPT-3 شروع کرد. پست این کاربر نشان میدهد که حداقل تعدادی از افراد باور دارند که GPT-3 شغلشان را از آنها خواهد گرفت. در آن طرف ماجرا نیز افرادی هستند که به بحث بازنشستگی زودتر از موعد و یا یادگیری و پرورش تواناییهای جدید همگام با پیشرفتهای روزمره تکنولوژی روی آورده و از آن پشتیبانی میکنند. همانگونه که افرادی این تکنولوژی به نام GPT-3 را به عنوان قدم برداشتن در سوی هوش مصنوعی عمومی میدانند، گروهی دیگر نیز باور دارند که تواناییهای GPT-3 دست بالا گرفته شده و بسیاری از پیشبینیها در ایٰنباره نمیتواند محقق شود.

- جاناتان لی، پژوهشگری در طراحی تجربهی کاربری، نیز در مورد نگرانیهای شغلی مردم در پست خود با موضوع «بیایید در مورد هوش مصنوعی GPT-3 که طراحان را به لرزه خواهد انداخت حرف بزنیم» صحبت کرد و گفت مردم باید از نگرانیهای خود برای از دست دادن شغلشان بکاهند.

- برخلاف تصور فعلی بشریت از اتوماتیک شدن ساختوسازها، هوش مصنوعی میتواند جریان کار را آسان کند تا دیگر نیازی نباشد ما با کارهای طاقتفرسا و وقتگیر در انجام کاری خسته بشویم. این کار به انسانها اجازه میدهد تا جستوجوهای خلاقانه و تفکراتی جدید داشته باشند که خود باعث میشوند ما آزاد باشیم تا بتوانیم نمونههای طراحی جدیدی نیز خلق کنیم. در این مسئلهی هوش مصنوعی بستگی دارد که ما چگونه از آن استفاده خواهیم کرد.

سم التمن، مدیرعامل OpenAI، به حواشی این موضوعات این گونه پاسخ داد: «هرچند ما با این تکنولوژی به پیشرفت بسیاری زیادی در زمینه هوش مصنوعی رسیدهایم ولی هنوز زمینههای زیادی در همین مبحث هوشمصنوعی وجود دارد که انسان هنوز به آنها دست نیافته است.

هیاهوی پیرامون GPT-3 بسیار زیاد بوده و این واقعا جالب است. ولی نقطه ضعفهایی دارد و گاهی هم باعث اشتباهاتی احمقانه میشود. هوش مصنوعی قرار است در آینده دنیا را تغییر دهد ولی GPT-3 فقط یک سرچشمهی آن است. چیزهای بسیاری برای یافتن هنوز باقیست.

به طور خلاصه، بسیاری از متخصصان مثالهای جالبی در مورد مقایسهی زبان طبیعی با GPT-3 زدند. رسانهها و مجامع تکنولوژی هر دو پیشرفت OpenAI را تبریک گفته. و در عین حال این هشدار را دادند که ممکن است این باعث آشفتگیهای تکنولوژی عظیمی در آینده شود. بههرحال، مدیرعامل OpenAI با نظرات محققان و منتقدان این تکنولوژی همراهی میکند. و میداند که GPT-3 پیشرفت و جهش عظیمی را در زمینه هوش مصنوعی نشان میدهد، ولی نمیتواند واقعا زبان را درک کند. و اینکه مشکلات مهمی در استفاده از این مدل در دنیای واقعی وجود دارد. میتوان از این مشکلات، به جهتگیریها و زمان تمرین آن نام برد.

محدودیتهای GPT-3 چیست؟

سیستم جدید یادگیری با نمونههای کم (few-shot learning) بهبود قابل توجهی را در زمینه هوش مصنوعی به ارمغان آورده است. این پیشرفتها و تواناییهای GPT-3 باعث شده است که تنها با تغییر و بزرگتر کردن مقیاس سیستمهای قبلی، به پیشرفتهای چشمگیری برسیم.

اما نتایج برجستهای که GPT-3 به نمایش گذاشته است، باعث شده است که در این زمینه یک هیاهو بسیار بالا برود. ما برخی نکات را درباره کاهش این هیاهو بیان خواهیم کرد. به طور کلی، قابلیتهای فراوان GPT-3 و توانایی انجام کارهای مختلف، باعث نگرانیهایی درباره تهدید به شغلهای مرتبط شده است، مانند جملهای که میگوید «ممکن است هوش مصنوعی کدنویسان و حتی تمام صنایع را بازنشسته کنند و کنار بزنند». با این حال، درک کنید که GPT-3 هر چند پیشرفتهای قابل توجهی داشته باشد، اما همچنان هوش واقعی را ندارد و نمیتواند به طور کامل جای کارکنان را بگیرد.

گذشته از همهی اینها، مدل GPT-3 شبیه همهی مدلهای پیشین خود است و فقط پیشرفتهتر شده است. با این که بزرگتر کردن مقیاس تمرینی، نتایج عملکردی بسیار عالی داشت ولی GPT-3 محدودیتهایی که در ادامه ذکر خواهیم کرد را با خود دارد.

- نداشتن حافظهی طولانی مدت (به گونهای که الان GPT-3 کار میکند، نمیتواند چیزی را شبیه انسانها بعد از فعل و انفعالات موفق یاد بگیرد.)

- محدودیت حجم ورودی (در مورد GPT-3، درخواستهای بیشتر از چند جمله نمیتوانند اجرا شوند.)

- فقط میتواند با متن کار کنند (پس نمیتواند با تصویر، صدا یا هر چیز دیگری که انسان به راحتی به آنها دسترسی دارد کار کند.)

- نبود اعتماد (GPT-3 در زمینههایی مبهم است و برای همین هیچ گونه گارانتی برای این که متن اشتباه یا مشکلداری در پاسخ به بعضی سوالات تولید کند وجود ندارد.)

- ناتوان در تفسیر (وقتی GPT-3 با روشهایی تعجبآور کار میکند، ممکن است که تصحیح یا جلوگیری از چنین شرایطی را سخت یا حتی غیر ممکن بسازد.)

- استنتاج آهسته (مدلهای فعلی GPT-3 به علت مقیاس بالای تصمیمگیریهای صورت گرفته، گران و نامناسب هستند.)

تاثیر GPT-3 بر مشاغل آینده چیست؟

با این حال، هرچند فناوریهای مشابه GPT-3 میتوانند در آینده تأثیراتی بر روی مشاغل داشته باشند، این بدان معنا نیست که این مشاغل به طور کامل از بین خواهند رفت. پذیرش تکنولوژیهای جدید معمولاً یک فرآیند تدریجی و زمانبر است و بسیاری از فناوریهای هوش مصنوعی به جای جایگزینی کامل شغلها، به افراد کمک خواهند کرد. به ویژه، مدلهای هوش مصنوعی نیازمند نظارت انسانی هستند تا از بروز نواقص احتمالی جلوگیری کنند. به عنوان مثال، در زمینه توسعه وب، فردی با تخصص فنی باید برای نوشتن و اصلاح کدهای GPT-3 دخالت کند.

شرکتهای فعال در زمینه بینایی کامپیوتری نیز نگرانیهای مشابهی داشتند پیش از ورود به پردازش زبان طبیعی. به عنوان مثال، هوش مصنوعی ممکن است برخی از شغلهای پزشکی را تهدید کند. با این حال، به جای جایگزینی پزشکان مانند رادیولوژیستها، هوش مصنوعی میتواند کار آنها را تسهیل کند. برای مثال، کرتیس لانگلوتز، رادیولوژیست دانشگاه استنفورد، معتقد است که هوش مصنوعی جای رادیولوژیستها را نمیگیرد، بلکه رادیولوژیستهایی که از هوش مصنوعی استفاده میکنند، موفقتر خواهند بود. این موضوع ممکن است برای GPT-3 نیز صادق باشد؛ اما در نهایت، GPT-3 تنها یک مدل است و هیچ مدلی به طور کامل بینقص نیست.

بعضی معتقدند که GPT-3 قدم بزرگی در راه هوش مصنوعی است یا به عبارتی هوش مصنوعی عمومی؛ شبیه چیزی که انسانها دارند. در عینحال که پیشرفت خود را نشان میدهد، این مهم است که در مورد نکتهای مهم برخلاف این هیاهوها حرف بزنیم. امیلی بندر، متخصص زبانشناسی محاسباتی، از دانشگاه واشنگتن و الکساندر کولراز دانشگاه سارلند به تازگی تستی به نام تست هشتپا را پیشنهاد دادند. در این آزمایش، دو نفر در یک جزیره دورافتاده زندگی میکنند و از طریق یک کابل در کف اقیانوس با هم ارتباط برقرار میکنند.

در جایی که اختاپوس به مکالمات این دو نفر گوش میدهد، میتواند به عنوان یک پراکسی برای مدلهای زبانی مانند GPT-3 عمل کند. در نهایت، اگر اختاپوس بتواند خودش را جای یکی از این دو فرد قرار دهد و موفق شود آزمایش را قبول کند، آنگاه این مدلها اثبات شده است. اما این دو محقق نمونههایی از شرایطی که اختاپوس نمیتواند در این آزمایش موفق باشد مورد بررسی قرار دادند، مانند ساخت وسایل یا دفاع شخصی. دلیل این مسئله این است که این مدلها تنها قادرند با متون برخورد کنند و از دنیای واقعی که بر روی درک زبانی تأثیر زیادی دارد، چیزی نمیدانند.

بهبود GPT-3 و نسخههای آینده آن میتواند مشابه زمانی باشد که اختاپوس را برای انجام بهترین کاری که قبلاً انجام میدهد، آماده کنیم. هر چند که مدلهای مانند GPT-3 روز به روز پیچیدهتر میشوند، اما نقاط قوت و ضعف متفاوتی از خود نشان خواهند داد. اما تنها یادگیری از متون یک مدل آموزش داده شده در دادههای بزرگ است. درک و فهم واقعی از تعامل زبانها، ذهنها و دنیای واقعی، چیزی است که هوشهای مصنوعی مانند GPT-3 قادر به تجربه آن نیستند.